Hvad er en søgemaskine? Fuldstændig guide til hvordan Google, Bing og søgealgoritmer fungerer

Master søgemaskinegrundlæggende med denne omfattende guide. Lær hvordan søgemaskiner fungerer, forstå crawling- og indekseringsprocesser, og opdag de algoritmer, der bestemmer søgerangeringer for milliarder af forespørgsler dagligt.

Hvad er en søgemaskine?

En søgemaskine er et komplekst softwaresystem designet til at søge efter information på internettet, hente og vise relevante resultater baseret på brugerforespørgsler. Søgemaskiner som Google, Bing og Yahoo fungerer gennem tre grundlæggende processer: crawling (opdagelse af websider via automatiserede bots), indeksering (analyse og opbevaring af indhold i massive databaser) og rangering (algoritmisk bestemmelse af, hvilke resultater der bedst matcher hver søgeforespørgsel). Moderne søgemaskiner behandler milliarder af forespørgsler dagligt, ved hjælp af sofistikeret kunstig intelligens og maskinlæring til at forstå brugerens hensigt og levere stadig mere præcise resultater.

At forstå søgemaskinearkitektur er fundamentalt for SEO-succes, da optimeringsstrategier skal tilpasses, hvordan disse systemer opdager, vurderer og rangerer indhold på tværs af billioner af websider.

Hvorfor forståelse af søgemaskiner er kritisk for digital succes

- Primær trafik kilde: Søgemaskiner driver 53% af al websteds trafik, mere end nogen anden kanal

- Kommersiel hensigt: Søgebrugere har specifikke behov og høj konverteringspotentiale

- Langsigtet synlighed: Søgemaskinerangeringer giver bæredygtig, sammensat trafikvækst

- Tillid og autoritet: Høje søgemaskinerangeringer signalerer troværdighed og ekspertise til potentielle kunder

- Omkostningseffektiv markedsføring: Organisk søgning leverer bedre ROI end de fleste betalte reklamekanaler

De tre kerneprocesser: Hvordan søgemaskiner faktisk fungerer

Crawling: Opdagelse og adgang

Søgemaskinebots (også kaldet spidere eller crawlers) gennemser konstant internettet, følger links fra side til side for at opdage nyt og opdateret indhold. Crawlers respekterer robots.txt-filer og prioriterer vigtige sider baseret på faktorer som opdateringsfrekvens, intern linking og domæneautoritet.

Indeksering: Analyse og opbevaring

Efter crawling analyserer søgemaskiner sideindhold—tekst, billeder, videoer og kode-struktur—og udtrækker betydning og kontekst. Disse behandlede oplysninger opbevares i massive indeksdatabaser, der organiserer billioner af websider til øjeblikkelig hentning, når brugere søger.

Rangering: Relevans og kvalitetsvurdering

Når brugere indsender forespørgsler, sammenligner søgemaskiner dem med indekseret indhold ved hjælp af hundrede rangfaktorer for at bestemme, hvilke sider der bedst opfylder søgehensigten, idet de overvejer relevans, autoritet, brugeroplevelse og friskhed.

Hovedtyper af søgemaskiner og deres anvendelser

- Generelle søgemaskiner: Google, Bing og Yahoo betjener brede forespørgsler på tværs af alle emner

- Vertikale søgemaskiner: Amazon (produkter), YouTube (videoer), LinkedIn (professionelle) specialiserer sig i specifikt indhold

- Privatlivsfokuserede motorer: DuckDuckGo og Brave Search prioriterer brugerens privatliv over personalisering

- AI-forstærkede motorer: Perplexity og You.com integrerer samtale-AI med traditionel søgning

- Virksomhedssøgning: Interne søgesystemer for organisationer, der bruger lignende principper i mindre skala

Hvorfor Google dominerer: Forståelse af markedsandel og brugerpræference

Google har cirka 92% af den globale søgemarkedandel på grund af overlegen algoritmekvalitet, massive infrastrukturinvesteringer, maskinlæringsinnovationer som RankBrain og BERT, og kontinuerlige forbedringer af brugeroplevelsen. Google behandler over 8,5 milliarder søgninger dagligt, hvilket gør det til det primære fokus for de fleste SEO-strategier.

Dog kan optimering for Bing (2,9% markedsandel) og andre alternativer fange værdifulde nichepublikummer, især i specifikke demografiske grupper og regioner, hvor alternative motorer har en stærkere tilstedeværelse.

Sådan optimerer du dit websted til søgemaskiner: Trin-for-trin guide

Trin 1: Sørg for korrekt crawling og indeksering

- Indsend dit XML-sitemap til Google Search Console og Bing Webmaster Tools

- Opret en klar robots.txt-fil, der tillader crawleradgang til vigtigt indhold

- Implementer en logisk sitearkitektur med en klar intern linkingstruktur

- Reparer brudte links, omdirigeringskæder og crawlfejl regelmæssigt

- Sørg for hurtige serverrespons tider og minimale tekniske barrierer for crawlers

Trin 2: Optimer for søgemaskinealgoritmer

- Udfør søgeordsforskning for at forstå, hvad brugerne faktisk søger efter

- Opret indhold af høj kvalitet, der opfylder søgehensigten

- Optimer titeltags, metabeskrivelser og header-tags med målrettede søgeord

- Byg naturlige, autoritative backlinks fra anerkendte websteder

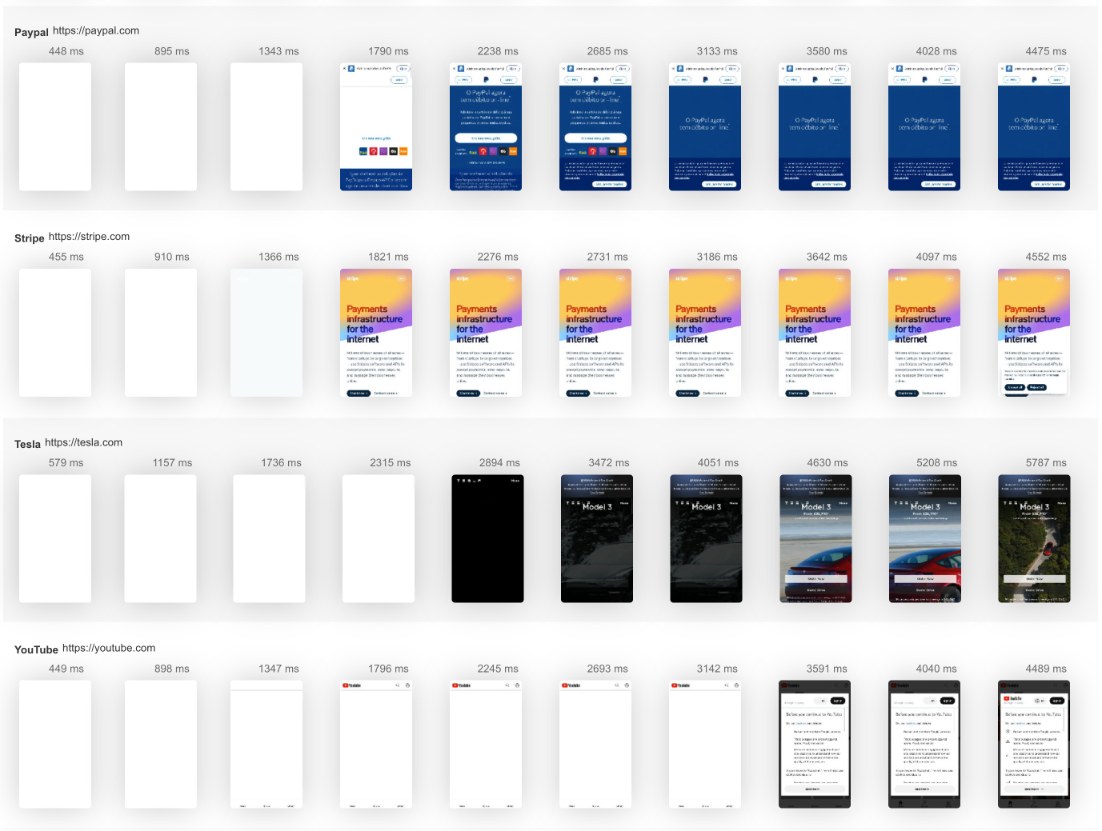

- Sørg for mobilvenlighed og hurtige sideindlæsningstider for positive brugersignaler

Trin 3: Matcher brugerhensigt og giver værdi

- Analyser top-rangerede sider for at forstå, hvilke indholdsformater og dybde Google foretrækker

- Opret indhold, der grundigt besvarer spørgsmål og løser brugerproblemer

- Brug strukturerede data til at hjælpe søgemaskiner med at forstå din indholdskontekst

- Optimer for fremhævede uddrag og "Folk spørger også"-muligheder

- Opdater regelmæssigt indhold for at opretholde friskhed og relevanssignaler

Trin 4: Overvåg præstation og tilpas

- Følg rangeringer, trafik og konverteringer i Google Analytics og Search Console

- Analyser brugeradfærdsmålinger: afvisningsrate, tid på side og engagementssignaler

- Hold dig informeret om algoritmeopdateringer og juster strategier i overensstemmelse hermed

- Udfør regelmæssige tekniske SEO-audits for at identificere og løse problemer

- Test og iterer baseret på datadrevne indsigter fra søgepræstation

Bedste praksis for søgemaskineoptimering for langsigtet succes

- Fokus på brugeroplevelse: Søgemaskiner belønner i stigende grad sider, der virkelig hjælper brugerne

- Kvalitet frem for kvantitet: Opret færre, exceptionelle sider i stedet for mange tynde indholdssider

- Teknisk fundament: Oprethold fremragende sidehastighed, mobiloptimering og sikkerhed (HTTPS)

- Naturlig linkbygning: Tjen backlinks gennem værdifuldt indhold i stedet for manipulerende taktikker

- Kontinuerlig forbedring: SEO er en løbende proces—opdater og optimer regelmæssigt eksisterende indhold

Søgemaskine FAQ: Almindelige spørgsmål besvaret

Hvor ofte crawler søgemaskiner websteder?

Crawlfrekvensen varierer dramatisk baseret på siteautoritet, opdateringsfrekvens og vigtighed. Højautoritative nyhedssider kan blive crawlet hvert par minutter, mens små, statiske sider måske bliver crawlet ugentligt eller månedligt. Regelmæssige indholdsopdateringer og stærk intern linking opmuntrer til hyppigere crawling.

Kan du betale søgemaskiner for bedre organiske rangeringer?

Nej, organiske søgemaskinerangeringer kan ikke købes—de bestemmes udelukkende af algoritmisk evaluering af din sides kvalitet og relevans. Betalte søgeannoncer (som Google Ads) vises separat og er tydeligt mærket, uden direkte indflydelse på organiske rangeringer.

Hvordan håndterer søgemaskiner duplikeret indhold?

Søgemaskiner identificerer duplikeret indhold og vælger typisk én version som kanonisk, mens de filtrerer andre fra resultaterne. Selvom det ikke straffes direkte, fortyndes rangpotentialet af duplikeret indhold. Brug kanoniske tags til at angive foretrukne versioner og undgå intern duplikation.

Hvad er forskellen mellem indeksering og rangering?

Indeksering betyder, at din side er gemt i søgemaskinens database og berettiget til at vises i resultaterne. Rangering bestemmer, hvor i resultaterne din side vises. En side kan være indekseret, men rangere dårligt, eller ikke vises overhovedet, hvis den anses for irrelevant for specifikke forespørgsler.

Læs og vurderer søgemaskiner billeder og videoer?

Ja, moderne søgemaskiner bruger computer vision og maskinlæring til at analysere visuelt indhold. Dog er de stadig stærkt afhængige af omkringliggende tekst, alt-attributter, billedtekster og metadata for fuldt ud at forstå konteksten. Optimer billeder med beskrivende filnavne, alt-tekst og relevant omkringliggende indhold.

AutoPush er den komplette AI-indholdsautomatiseringsplatform, der håndterer søgeordsforskning, artikelskrivning, SEO-optimering og automatisk udgivelse. Vækst din organiske trafik 24/7 uden at ansætte skribenter eller lære SEO — betroet af 10.000+ virksomheder.Start 7-dages gratis prøveperiode→